ChatGPT është një autor i punimeve shkencore – çfarë do të thotë kjo për të ardhmen e kërkimit shkencor?

Chatbot ChatGPT me inteligjencë artificiale (AI) që magjeps pothuajse të gjithë botën me përgjigjet e tij “të menduara” ndaj pyetjeve specifike, të tilla si aftësia për të prodhuar linja programore pa gabime dhe në të njëjtën kohë për të debatuar pyetje filozofike, politike dhe çfarë jo, këtu është pikërisht tani, shfaqet i renditur në listën e autorëve të të paktën katër punimeve shkencore që janë botuar ose presin të botohen. Shfaqja ka ngjallur debat midis redaktorëve të revistave, komunitetit shkencor dhe botuesve për vendin e një mjeti të AI në botime dhe sa e përshtatshme është që një chatbot të renditet si autor.

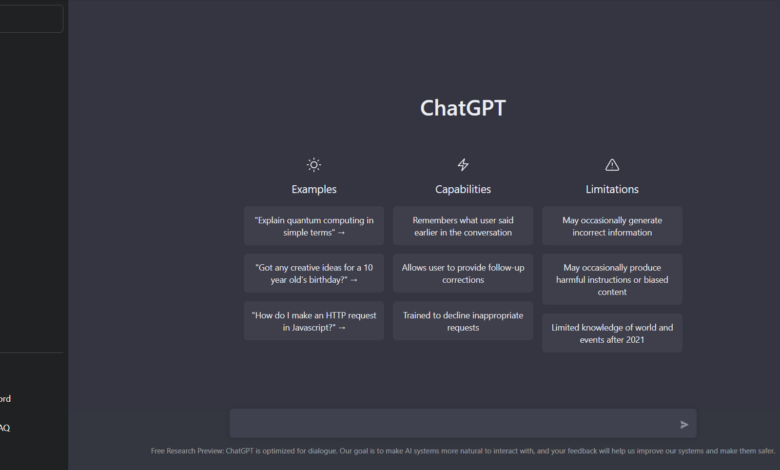

ChatGPT është një model i madh gjuhësor (LLM), i cili gjeneron fjali bindëse duke imituar modelet statistikore të gjuhës të disponueshme nga baza e të dhënave të gjera të të dhënave tekstuale të mbledhura nga Interneti. Me aftësinë e tij, roboti tashmë ka bërë bujë në një sërë fushash, duke përfshirë shkencën, duke ngritur pyetje shqetësuese për të ardhmen e eseve dhe kërkimeve universitare. Dhe me te drejte…

Ekziston një marrëveshje e përgjithshme midis botuesve dhe shërbimeve të printimit të kontaktuar nga ekipi i lajmeve të Nature se një AI si ChatGPT nuk i plotëson kriteret për të qenë autor i studimit, pasi ai dhe mjete të ngjashme nuk mund të marrin përgjegjësi për përmbajtjen dhe integritetin e punimeve shkencore. Por disa botues thonë se kontributi i AI në shkrimin e letrës ende mund të pranohet në seksione të tjera përveç listës së autorëve.

Gjegjësisht, kur ekipi gazetaresk i Natyrës kontaktoi me redaktorët e katër revistave shkencore në të cilat ChatGPT figuron në listën e bashkautorëve , dy prej tyre u përgjigjën se ishte një gabim që do të korrigjohej, njëri prej tyre nuk iu përgjigj pyetjeve. fare, dhe sipas të fundit nga redaktorët e kontaktuar, VI është renditur si bashkëautore sepse ajo e rishkruan të gjithë punimin pas kritikave të marra nga recensentët, dhe për këtë arsye statusi i bashkautorit mund të konsiderohet mjaft i përshtatshëm.

Por kjo nuk është e vetmja dhimbje koke që ChatGPT u jep redaktorëve. Një chatbot i inteligjencës artificiale mund të shkruajë abstrakte të tilla bindëse të rreme për një punim kërkimor që shkencëtarët shpesh nuk i vënë re, sipas një artikulli që u bë i disponueshëm në serverin preprint bioRxiv në fund të dhjetorit.

Studiuesit i kërkuan chatbot-it të shkruante 50 abstrakte kërkimore mjekësore bazuar në një përzgjedhje të abstrakteve të botuara në revistat shkencore JAMA, The New England Journal of Medicine, The BMJ, The Lancet dhe Nature Medicine. Ata më pas i krahasuan këto abstrakte (të shkruara nga AI) me abstraktet origjinale, duke i përdorur ato përmes një detektori plagjiaturë dhe një detektori të prodhimit të gjeneruar nga AI, dhe i kërkuan një grupi studiuesish mjekësorë të zbulonin abstraktet e fabrikuara.

Abstraktet e krijuara nga ChatGPT kaluan kontrollin e plagjiaturës – rezultati mesatar i origjinalitetit ishte 100%, që në thelb do të thotë se është një tekst origjinal. Detektori i daljes i gjeneruar nga AI ishte disi më i suksesshëm dhe zbuloi 66% të abstrakteve të krijuara. Por recensuesit njerëzorë nuk rezultuan të ishin shumë më të suksesshëm si detektorë – recensuesit arritën të identifikonin vetëm 68% të abstrakteve të krijuara dhe 86% të abstrakteve reale. Ata identifikuan gabimisht 32% të abstrakteve të krijuara si reale dhe identifikuan gabimisht 14% të abstrakteve reale si të krijuara.

Komuniteti shkencor është i ndarë në lidhje me implikimet që këto rezultate kanë për shkencën. Disa studiues besojnë se mosnjohja e punës së AI mund të ketë pasoja serioze, duke i shtyrë shkencëtarët të punojnë në drejtimin e gabuar, sepse kërkimi i tyre bazohet në rezultatet e kërkimit imagjinar. Por disa studiues i referohen kartës etike gjatë hulumtimit, kështu që fabrikimi i kërkimit nuk është diçka që do ta bënte një shkencëtar serioz. Dhe disa mendojnë se redaktorët e revistave shkencore duhet të krijojnë një sistem që do ta parandalonte këtë fenomen.

Në këtë drejtim është edhe editoriali i redaktorëve të Nature i publikuar javën e kaluar, i cili trajton këto probleme dhe në të cilin shpalos politikën e miratuar të të gjitha revistave nën ombrellën e Springer Nature. Gjegjësisht, në udhëzimet tashmë ekzistuese për autorët , ata shtuan dy parimet e mëposhtme: Së pari, asnjë mjet LLM nuk do të pranohet si autor i kredituar i një punimi kërkimor – çdo atribuim i autorësisë mbart me vete përgjegjësinë për veprën, dhe mjetet e AI bëjnë. nuk mund të marrë një përgjegjësi të tillë. Së dyti, studiuesit që përdorin mjetet LLM duhet ta dokumentojnë këtë përdorim në seksionet e metodave ose të mirënjohjeve. Nëse punimi nuk përfshin këto seksione, hyrja ose seksioni tjetër i përshtatshëm mund të përdoret për të dokumentuar përdorimin e LLM.

Siç raportoi ekipi i gazetarisë së Nature, botues të tjerë shkencorë pritet të mbajnë një qëndrim të ngjashëm. Ekipi i gazetarisë së Nature është editorialisht i pavarur nga ekipi i revistës shkencore dhe nga botuesi i tij, Springer Nature.